Chris sagde

06 Aug 2018

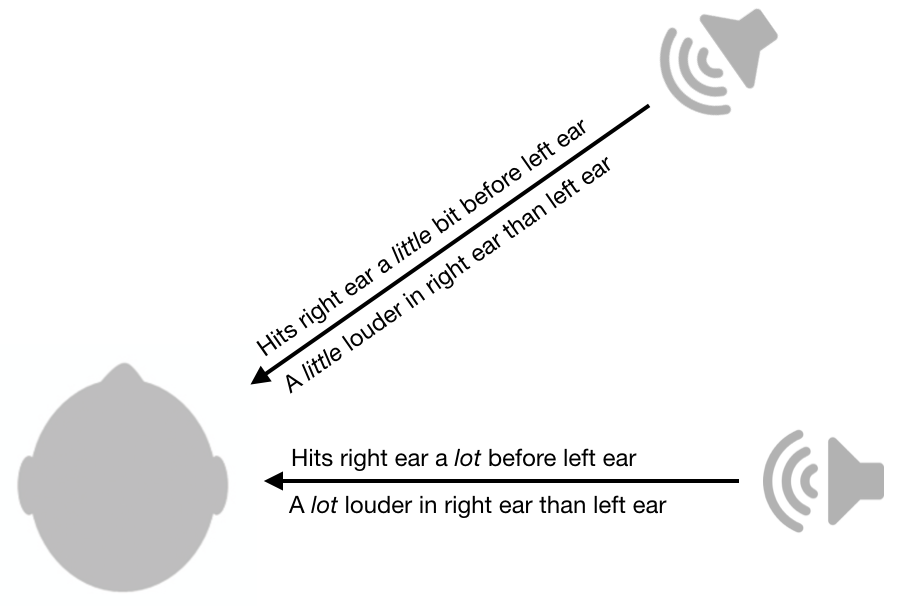

en af de sejeste ting, jeg nogensinde har lært om sensorisk fysiologi, er, hvordan det auditive system er i stand til at lokalisere lyde. For at afgøre, om lyden kommer fra højre eller venstre, bruger hjernen mellemøreforskelle i amplitude og timing. Som vist i figuren nedenfor, hvis lyden er højere i højre øre sammenlignet med venstre øre, kommer den sandsynligvis fra højre side. Jo mindre denne forskel er, jo tættere lyden er på midtlinjen (jeg.e det lodrette plan, der går fra din forside til din ryg). Tilsvarende, hvis lyden kommer til dit højre øre før venstre øre, kommer det sandsynligvis fra højre. Jo mindre tidsforskellen er, jo tættere er den på midtlinjen. Der er en fascinerende litteratur om de neurale mekanismer bag dette.

inter-ear loudness og timing forskelle er ret nyttige, men desværre forlader de stadig meget tvetydighed. For eksempel, en lyd fra din forreste højre vil have nøjagtig samme loudness forskelle og timing forskelle som en lyd fra din ryg højre.

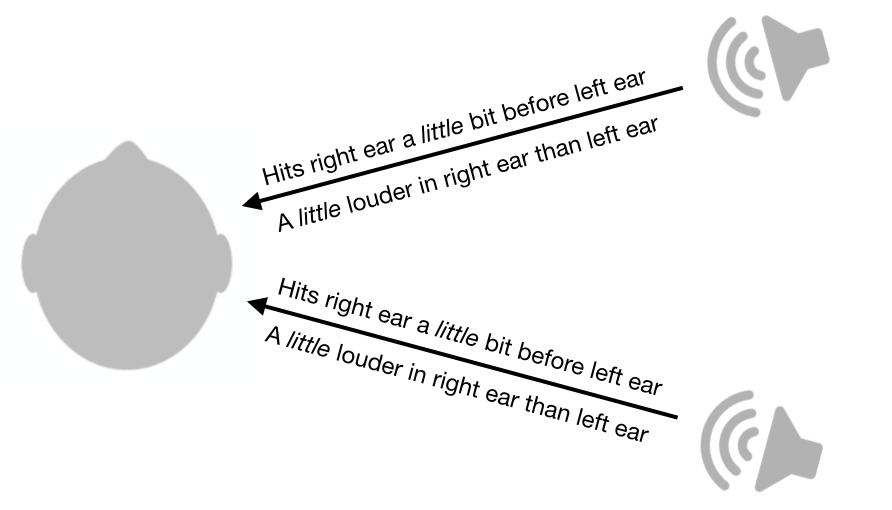

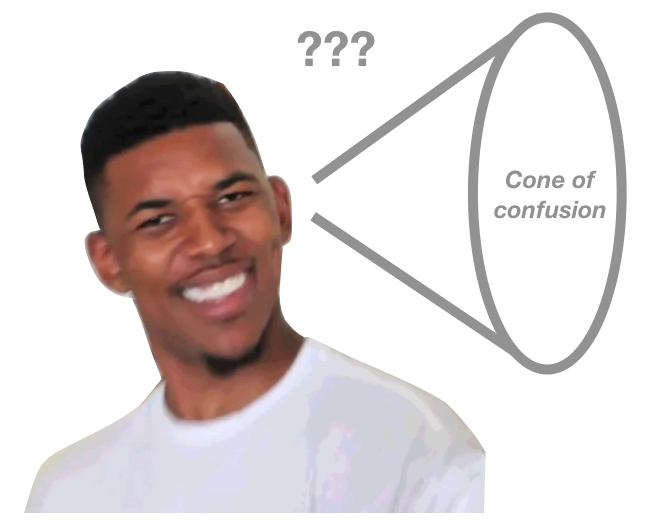

dette system efterlader ikke kun uklarheder mellem for og bag, det efterlader også uklarheder mellem top og ned. Faktisk er der en hel kegle af forvirring, der ikke kan disambigueres af dette system. Lyd fra alle punkter langs keglens overflade vil have de samme forskelle mellem øret og tidsforskelle.

mens dette system efterlader en kegle af forvirring, er mennesker stadig i stand til at bestemme placeringen af lyde fra forskellige punkter på keglen, i det mindste til en vis grad. Hvordan kan vi gøre det?

utroligt er vi i stand til at gøre dette på grund af formen på vores ører og hoveder. Når lyd passerer gennem vores ører og hoved, dæmpes visse frekvenser mere end andre. Kritisk er dæmpningsmønsteret meget afhængig af lydretningen.

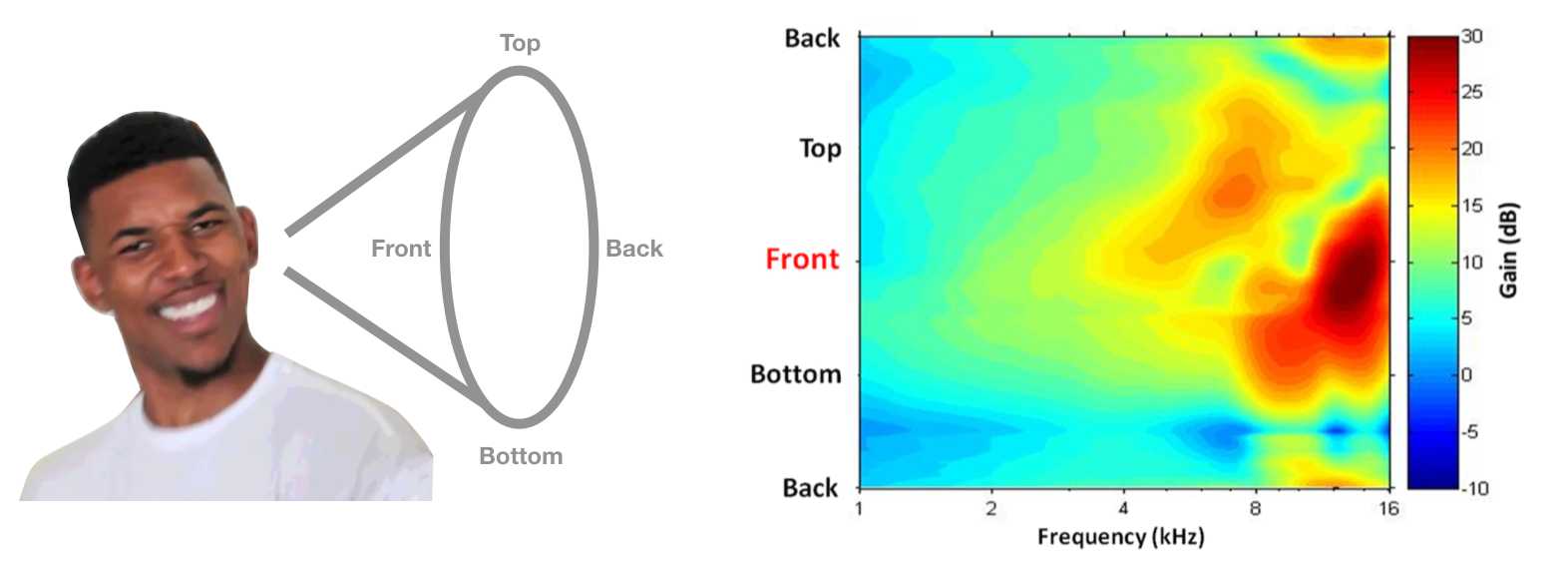

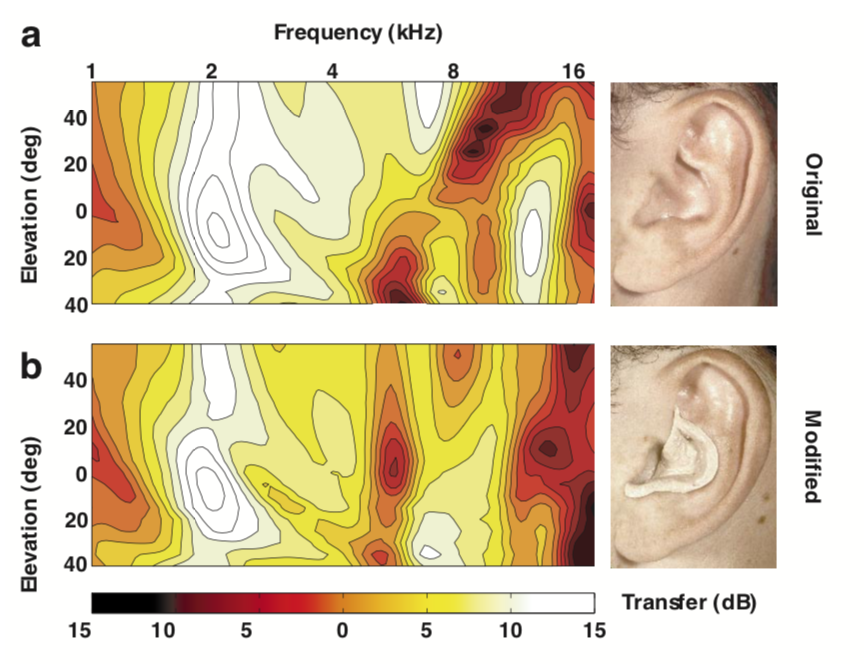

dette placeringsafhængige dæmpningsmønster kaldes en Hovedrelateret overførselsfunktion (HRTF), og i teorien kunne dette bruges til at disambiguere placeringer langs forvirringens kegle. Et eksempel på en persons HRTF er vist nedenfor med frekvens på den vandrette akse og polær vinkel på den lodrette akse. Varmere farver repræsenterer mindre dæmpning (dvs.mere strøm). Hvis dit hoved og ører gav dig denne HRTF, kan du beslutte, at en lyd kommer fra forsiden, hvis den har mere højfrekvent effekt, end du ville forvente.

HRTF-billede fra Simon Carliles psykoakustiske kapitel i Sonification Handbook.

dette system lyder godt i teorien, men bruger vi faktisk disse signaler i praksis? I 1988 udførte Doris Kistler et genialt sæt eksperimenter (1, 2) for at vise, at folk virkelig bruger HRTF ‘ er til at udlede placering. Først målte de HRTF for hver deltager ved at sætte en lille mikrofon i ørerne og spille lyde fra forskellige steder. Derefter oprettede de et digitalt filter for hver placering og hver deltager. Det vil sige, at disse filtre implementerede hver deltagers HRTF. Endelig placerede de hovedtelefoner på lytterne og spillede lyde til dem, hver gang de passerede lyden gennem et af de digitale filtre. Forbløffende var deltagerne i stand til korrekt at gætte” placeringen ” af lyden, afhængigt af hvilket filter der blev brugt, selvom lyden kom fra hovedtelefoner. De var også meget bedre til lydlokalisering, når de brugte deres egen HRTF, snarere end andres HRTF.

yderligere beviser for denne hypotese kommer fra Hofman et al., 1998, der viste, at ved at bruge putty til at omforme folks ører, var de i stand til at ændre HRTFs og dermed forstyrre lydlokalisering. Interessant nok var folk i stand til hurtigt at genlære, hvordan man lokaliserer lyd med deres nye HRTF ‘ er.

billede fra Hofman et al., 1998

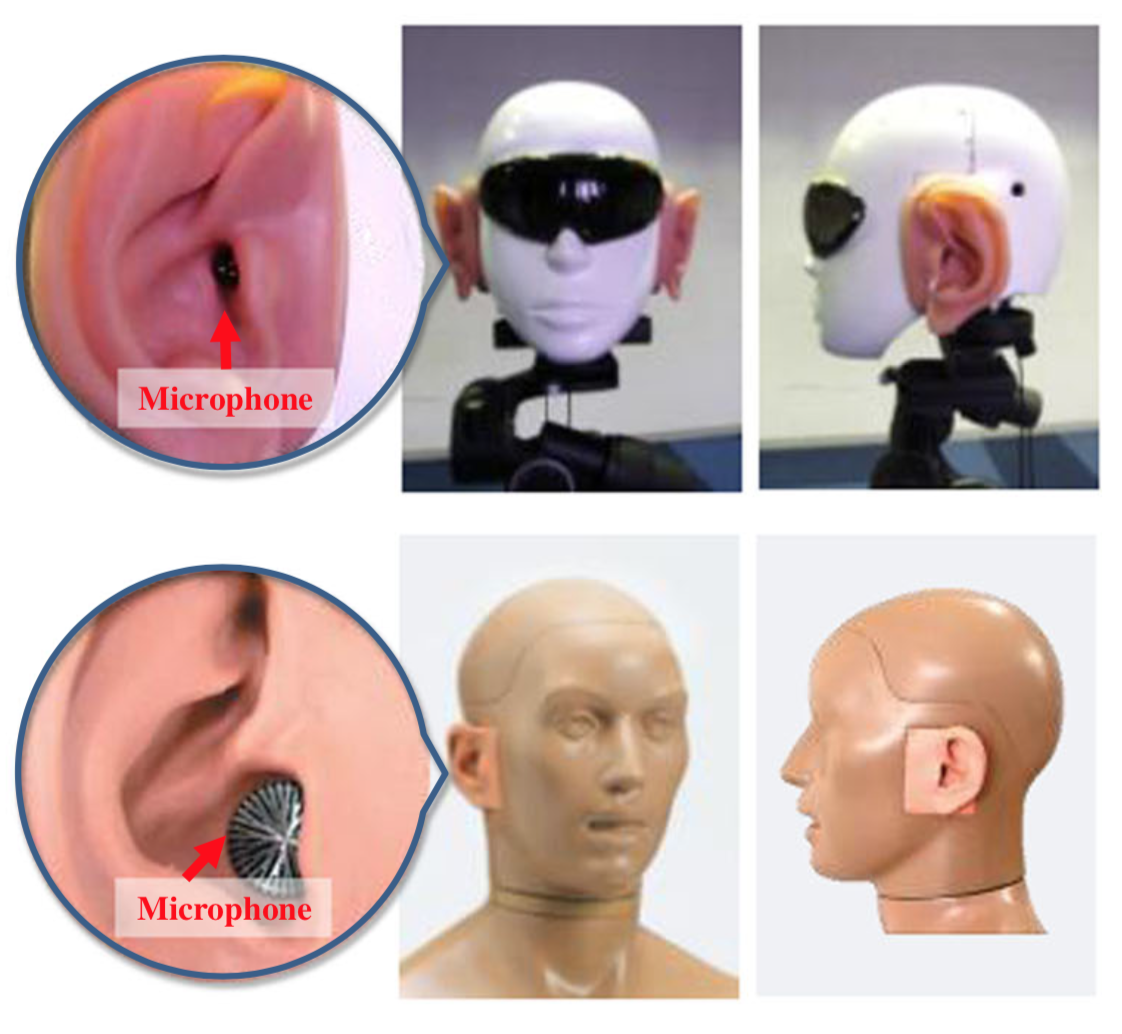

en sidste sjov kendsgerning: for at forbedre lydlokaliseringen af humanoide robotter fastgjorde forskere i Japan kunstige ører til robothovederne og implementerede nogle sofistikerede algoritmer for at udlede lydplacering. Her er nogle billeder af robotterne.

deres papir er lidt latterligt og har nogle tvivlsomme begrundelser for ikke kun at bruge mikrofoner flere steder, men jeg syntes det var sjovt at se disse principper blive anvendt.